Sicherheit in der KI-Ära: Herausforderungen, Angriffsszenarien und ganzheitliche Schutzstrategien

Übersicht

Das Bundesamt für Sicherheit in der Informationstechnik (BSI) zeigt in ihrem jährlichen Bericht zur Lage der IT-Sicherheit in Deutschland, dass im vergangenen Jahr täglich etwa 70 neue Schwachstellen in Software-Produkten registriert werden. Das entspräche einem Zuwachs von etwa 24 Prozent. Außerdem verweist das BSI darauf, dass der Einsatz von (generativer) Künstlicher Intelligenz zwar neue Chancen schaffe, aber auch neue Bedrohungen hervorbringe. Wie Software-Produkte selbst können KI-Systeme selbst zur Schwachstelle werden, aber auch neue Angriffsszenarien hervorbringen. So kann generative KI beim Phishing und der Generierung von Desinformation, Deepfakes oder Schadcode zum Einsatz kommen.

Was ist damit gemeint?

Beim Aufbau und dem Betrieb von IT-Systemen bezüglich der Datensicherheit beschreibt die CIA-Triade die wichtigen IT-Schutzziele: Confidentiality (Vertraulichkeit), Integrity (Integrität) und Availability (Verfügbarkeit).

- Confidentiality (Vertraulichkeit): Daten sollten vertraulich behandelt und nur von autorisierten Nutzern eingesehen werden können. Dies betrifft sowohl ihren Zustand während ihrer Speicherung als auch während einer möglichen Datenübertragung.

- Integrity (Integrität): Die Integrität von Daten verlangt einerseits, dass sowohl die Daten als auch die Funktionsweise des verarbeitenden Systems korrekt sind (Daten- und Systemintegrität). Zudem müssen vorgenommene Änderungen an den Daten, die im Zuge von Geschäftsprozessen notwendig werden, nachvollziehbar sein.

- Availability (Verfügbarkeit): Hiermit ist gemeint, dass sowohl die informationstechnischen Systeme als auch die darin hinterlegten Daten möglichst jederzeit verfügbar sein müssen. Es soll verhindert werden, dass Daten verloren gehen oder der Zugriff unmöglich ist.

Ein Blick darauf zeigt, dass es sich hierbei um Spezifikationen für den Umgang und den Zugriff auf Daten an sich handelt. Die neuen Angriffsszenarien auf KI-Systeme existieren auch, wenn keine klassische Software- oder Hardwareschwachstelle (vgl. CWE) auftritt und alle Systeme technisch einwandfrei funktionieren.

Wie kann ein Angriff aussehen?

Zunächst muss ein Verständnis aufgebaut werden, was geschützt werden muss. Geheimhaltung der Technologien (security by obscurity) ist keine valide Strategie, da diese dem Angreifer vollständiges Unwissen unterstellt und nur ein sogenannter Black-Box Angriff möglich wäre.

Startet beispielsweise ein Angreifer einen Angriff auf ein KI-System, welches Bilddaten verarbeitet, wird diesem klar sein, dass es sich mit hoher Wahrscheinlichkeit um ein Deep-Learning Modell (Neuronale Netze) handelt. Je nach Zweck des Angriffs kann sich der Angreifer (Fehl-)Verhalten dieser Modelle zu Nutze machen. Dies wird ein Gray-Box Angriff genannt, da die Art der Modelle bekannt und lediglich die exakten Parameter unbekannt sind. Bei bekanntem Modell und Parametern wird von einem White-Box Angriff gesprochen.

Für White-, Gray und auch für Black-Box Angriffe zeigen Forschungen Strategien und Gegenmaßnahmen ebenso wie Aspekte des Datenschutzes in KI-Systemen.

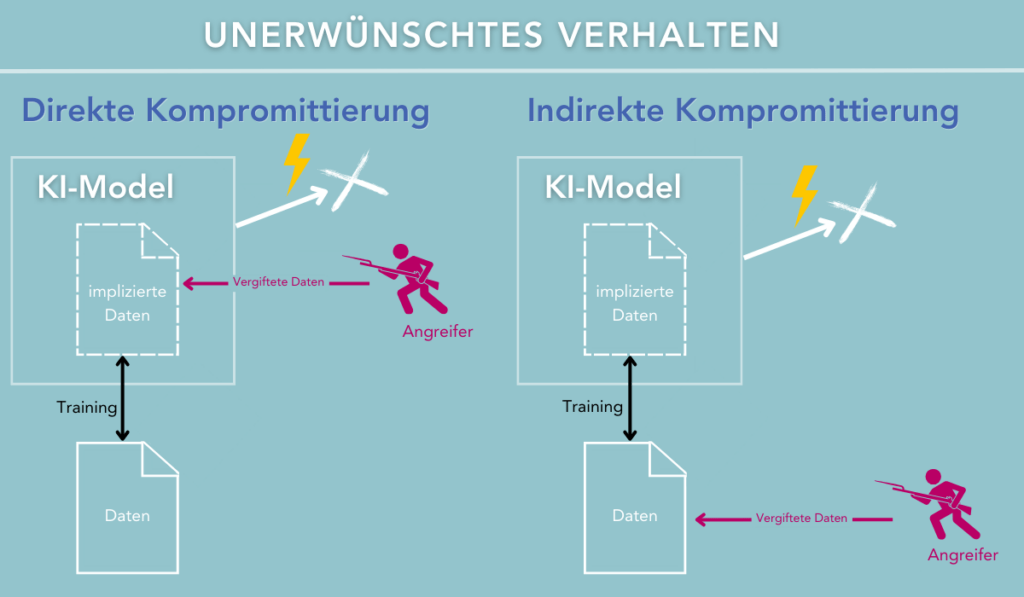

Grob lassen sich drei Angriffsziele beschreiben:

- Kompromittierung:

Ein Angriff kann direkt auf das Modell erfolgen, oder die (bekannten) Trainingsdaten können vergiftet werden, um Hintertüren oder (Fehl-)Verhalten in das System zu induzieren. Dies kann ohne direkten Zugriff auf das KI-System durchgeführt werden und stellt einen vollkommen neuen Angriffsvektor dar. Das Ziel ist das System zu kompromittieren und so global oder temporär Fehlverhalten zu induzieren und somit im extremen Fall das Modell unbrauchbar zu machen, oder das Vertrauen in das KI-System zu zerstören.

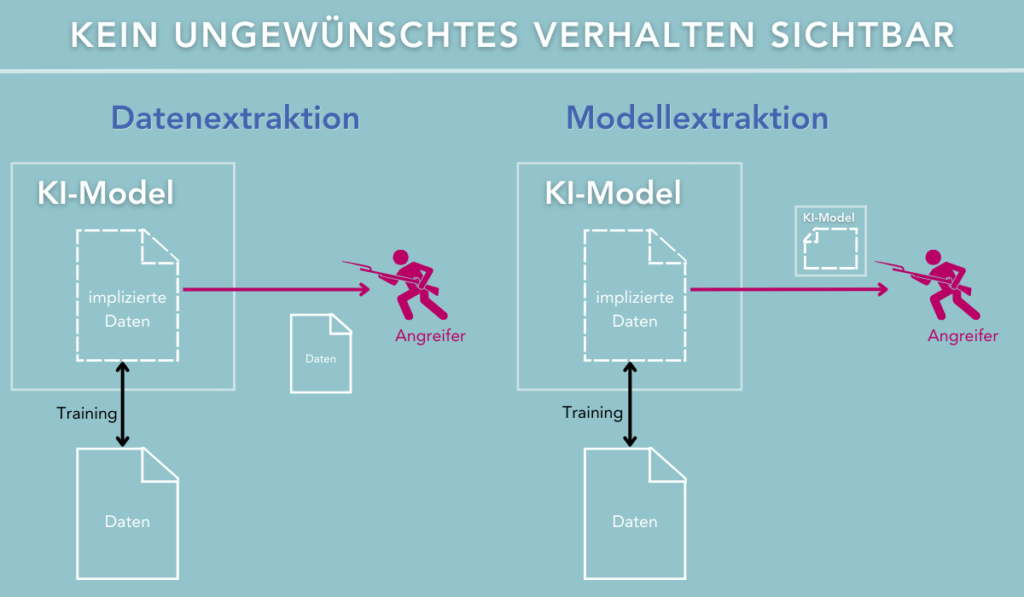

- Datenextraktion:

Auch müssen die Akteure verstehen, dass ein trainiertes Modell zwar keinen unmittelbaren Zugriff auf die genutzten Trainingsdaten hat, diese aber im KI-System enthalten sind und unter Umständen wieder extrahiert werden können. Ein sehr einfaches Beispiel ist die Frage an ein LLM (Large Language Model) nach Details aus einem Buch. (Mehr zum Thema Large Language Model erfahren Sie in unserem zweiteiligen Blogbeitrag: Teil 1 und Teil 2) – Erhalten wir eine positive Antwort können wir dies auf die Liste der Trainingsdaten setzen, obwohl der Urheber des Models diese Daten nicht veröffentlicht hat. Dies klingt wie eine Spielerei – bei einem Modell beispielsweise im Gesundheitswesen wird allerdings schnell klar, dass in keinem Fall nähere Details zu den Trainingsdaten oder betroffenen Personen bekannt werden dürfen.

- Modellextraktion:

Im Falle des KI-Systems als Produkt kann auch das Erlangen des Modells selbst das Ziel sein. Dabei wird das Modell nicht direkt erbeutet, sondern ein KI-System wird trainiert, welches anhand der Rückgabewerte des Zielmodells das Model rekonstruieren kann. Mögliche nachgelagerte Schritte sind Erpressung, ein White-Box Angriff auf das System, die kostenlose Nutzung des erbeuteten KI-Modells in einer eigenen Version bzw. die Verwendung als Konkurrenzprodukt.

Nochmal betont werden muss, dass sich in diesen Fällen das KI-System einwandfrei verhält und spezifisches Verhalten für einen Angriff ausgenutzt wird.

IT-Sicherheit: Eine Gesamtverantwortung

IT-Sicherheit sollte nicht als isolierte Aufgabe betrachtet werden, sondern als integraler Bestandteil des gesamten IT-Ökosystems. Eine ganzheitliche Betrachtung der IT-Sicherheit ist entscheidend, um die Effektivität und Effizienz der Sicherheitsmaßnahmen zu gewährleisten. Empfehlungen hierfür sind:

- Integration in den Entwicklungsprozess:

Sicherheit sollte von Anfang an in den Entwicklungsprozess integriert werden, anstatt erst am Ende hinzugefügt zu werden. Entwickler, Betreiber und Sicherheitsfachleute sollten zusammenarbeiten, um sicherheitsrelevante Entscheidungen zu treffen.

- Erkennung von Bedrohungen in Echtzeit:

Bedrohungen entwickeln sich ständig weiter, und Sicherheitsmaßnahmen müssen ebenso agil sein. Eine ganzheitliche Betrachtung ermöglicht die Echtzeiterkennung von Bedrohungen und eine sofortige Reaktion auf potenzielle Sicherheitsvorfälle.

- Vermeidung von Silos:

Isolierte Sicherheitsabteilungen können zu Informationsinseln führen, in denen wertvolle Erkenntnisse und Bedrohungsinformationen verloren gehen. Im Fall von KI-Systemen kann dies auch das KI-Team sein. Durch eine ganzheitliche Betrachtung können Informationen und Erkenntnisse aus verschiedenen Bereichen zusammengeführt werden, um ein besseres Verständnis der Sicherheitslage zu ermöglichen.

- Kontinuierliche Verbesserung:

Die IT-Sicherheit sollte ein kontinuierlicher Verbesserungsprozess sein, der auf einer ständigen Evaluierung und Anpassung basiert. Eine ganzheitliche Betrachtung ermöglicht eine bessere Identifizierung von Schwachstellen und die Implementierung von Sicherheitsmaßnahmen zur Risikoreduzierung. Bezüglich KI-Systemen können dies auch neue wissenschaftliche Erkenntnisse sein.

- Sensibilisierung und Schulung:

Die Sensibilisierung für IT-Sicherheit besonders bezüglich KI-Modellen sollte nicht auf die Sicherheitsabteilung beschränkt sein. Alle Mitarbeiter in einem Unternehmen sollten in Sicherheitsbewusstsein und bewährten Praktiken geschult werden, um die menschliche Komponente der Sicherheit zu stärken.

- Dokumentation und Analyse der KI-Systeme:

Genutzte Modelle und Verfahren (Model-Card), ebenso wie die Trainingsdaten (Datasheet for Datasets) sollten gut dokumentiert werden und wenn möglich in einem Data Catalog auffindbar sein. So können Bedrohungslagen frühzeitig identifiziert und eventuelle Schwächen beseitigt werden.

Unter Einbeziehung des gesamten Entwicklerteams und unter Berücksichtigung neuer Erkenntnisse kann eine Härtung der KI-Systeme durchgeführt werden.

Zusammenfassung

Innovative Technologien wie künstliche Intelligenz bieten sowohl Chancen als auch Risiken. Wie in Software-Produkten auch können KI-Systeme zu Schwachstellen werden oder sogar neue Angriffsszenarien bieten. Traditionelle Schutzmaßnahmen sind somit nicht mehr ausreichend. Die CIA-Triade gibt grundlegende IT-Schutzziele vor, welche sich in Vertraulichkeit, Integrität und Verfügbarkeit einteilen lassen. Doch die beschriebenen Angriffsszenarien auf KI-Systeme verdeutlichen, dass Angriffe auch ohne klassische Schwachstellen erfolgen können. IT-Sicherheit ist eine Gesamtverantwortung, welche integraler Bestandteil des gesamten Ökosystems und IT-Landschaft darstellt und niemals isoliert für eine einzelne Komponente oder Software-Produkt betrachtet werden darf.

Sicherheit von Anfang an: Dieses Ziel kann durch Maßnahmen wie Echtzeiterkennung, Vermeidung von Silos, kontinuierliche Verbesserung und Schulung aller Mitarbeiter erreicht werden. Gerade im Hinblick auf die rasant zunehmende Komplexität von IT-Sicherheitslandschaften im Zeitalter der KI wird die Weiterentwicklung von Schutzstrategien und -maßnahmen von entscheidender Bedeutung sein.